20225/9/1

今天是开学的第一天。ccc的老师上课挺有意思的,人看上去也还行。这种好老师怎么cs就没有几个呢?不过暂时还不知道他给grade怎么样,有的时候面善的人给分一给一个不吱声。希望他不是这种人,ustspace上的评分不低。 这老师下午就把自己“精心设计的”小桥段发到b站上了,这种中登还玩互联网的属实是不多见,他的评论区里何教授也经常发言,什么奇怪的物理科研小圈子。去给他评论了一下捧个场,下次问问他能不能给grade给好一点。。。。 cqf还是正常发挥,毫无疑问的ppt reader。如果你学过,你能听懂他在讲什么,而且逻辑还挺清晰的。但是如果没有基础,他讲的就是天书,主要这课和5214一样主打一个广而不深,如果想要精通主要还是看自己。 吐槽一点,前两节课的ppt和comp5214一模一样,不愧是他;还有港校的tpg真是水硕,或许中介口中要不错的本科背景才能申上,但是在港校呆一年上课,除了给个毕业证以外几乎不会有任何提升。 新学期,新气象;今天成功把手机屏幕时间压到7小时以内(其实是想看到6小时以内的,明天加油)。论文也看来一点点(其实也没有多少),有很多事情想做但又感觉没有时间。...

pytorch-day03

Text data Modeling Example IMDB数据集的目标是预测评论的情感标签 数据预处理 这里似乎只用了一个简单的构建词表,然后hard code每一个词?没有用到任何word-embedding。我很好奇这真的有用吗 这里我们定义了一个类用来处理数据1234567891011class ImdbDataset(Dataset): def __init__(self,df): self.df = df def __len__(self): return len(self.df) def __getitem__(self,index): text = self.df["text"].iloc[index] label = torch.tensor([self.df["label"].iloc[index]]).float() tokens = torch.tensor(text_pipeline(text)).int() ...

pytorch-day02

Image data Modeling examplePrepare dataset Using cifr-2 as an example Import necessary pakcage12345import torch from torch import nnfrom torch.utils.data import Dataset,DataLoaderfrom torchvision import transforms as Tfrom torchvision import datasets 1234567891011121314151617# define helper functiontransform_img = T.Compose( [T.ToTensor()])def transform_label(x): return torch.tensor([x]).float()# load dataset using Imagefolderds_train = datasets.ImageFolder("./eat_pytorch_datasets...

pytorch_day01

写在一开始被同学拉着一起学,那就正式学习一下pytorch. 择日不如撞日.* 代码部分放在colab上,这里总结一点主要/延申知识Day 1 Structured Data Modeling Example Using Titanic dataset. The goal is to predict whether a passenger is surived. The dataset contains 10 features,within them: 4 valued feature 4 categorical feature 2 other feauture(ticket number & name) Among the features, some of them has missing values The tutorial then do the data preprocessing, building a MLP with one hidden layer, and write the training function. About the O...

2025/8/25

好的,今天又是什么都没有做的一天。中午家里聚餐回来直接昏睡一个下午。回来躺在床上手机拿起来就放不下。我始终觉得刷短视频不如玩一会游戏,玩游戏不如学一点乱七八糟的知识,学乱七八糟的不如学正经知识。但是总是在使用最没有意义的行为浪费时间。 新的手柄到了,果然是一分钱一分货,用起来按键的手感,整体的做工好了不知一点。我也是从来没吃过好的,中高端的手柄都没有体验过。对于我这种游戏大的不多的,似乎高级手柄确实有一点感知不强。这种100~300之间的手柄刚刚好。以后再换手柄就在同价位里换一个别的,也不考虑升级了。 争取明天早上能够早起学习。下午我想学一下大模型的八股。教授总是不回waiver,明天催他一下,同时也要做好一下上别的课和自学的准备。晚上要开始修复一下数据准备模型复现,这个周四我不要赶工。

2025/8/23

由于开完会之后不知道在干什么,又是两天没有任何进展了,因此在这里写一下最近每天打算的任务。有了一些目标才会有动力去完成。 总结229的笔记和code,重新精炼一下每一次的Assignment,真正把知识沉淀下来。不然和上网随便上上网课的人有什么区别,我的学费不是白费了。 每天阅读1~2篇专业论文,阅读一篇经典方法的论文/学习一下经典方法的概念 学一点乱七八糟的新知识,like c++/pytorch或一些新的语言。现在也是时候把背单词捡起来了 开始复现/重构代码,我要提升自己的coding能力,不能只靠GPT了。 今天又爆米买了一个手柄,并且打算回hk之后买一个显示器,我不想周末上山去抢图书馆的显示器了。我是是一个讨厌附近有人的人,可能我比较讨厌人类吧。前前后后加起来也快花掉1000多块了,感觉有点放纵了。 来点中二句子: Per aspera ad astra 循此苦旅,终抵繁星

Histgen_Paper

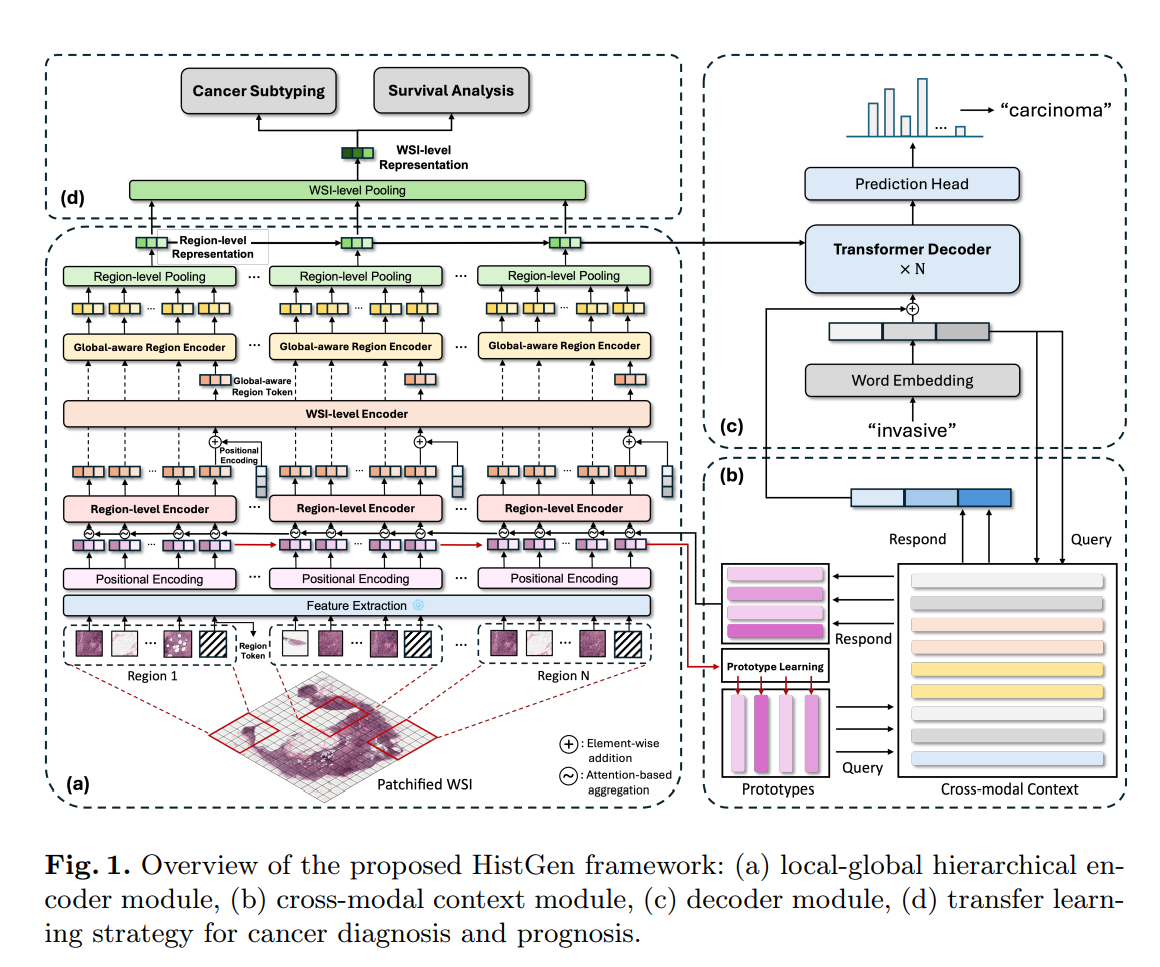

Histgen Code: https://github.com/dddavid4real/HistGen Data: https://huggingface.co/datasets/david4real/HistGen Abstract 自动生成病理学报告,减轻工作量 Pathology 是 癌症诊断的黄金标准 基于多实例学习并且发布了数据集 两个模块 局部-全局分层编码器 跨模态上下文模块 有强大迁移学习能力 Introduction Background: 数字化WSI得以普及,推动CPATH发展 WSI Gigabyte 和GPU的限制,MIL被用于WSI分析 Motivation: 撰写报告是劳动密集且容易出错的任务,自动化生成很有前景 MIL 领域集中在WSI级别的预测,很少有WSI report 生成 Challenges: 缺少数据集,数据集主要关注patch级别的图像和标题,忽略了全面,全局性的描述 WSI 图像巨大,阻碍现有方法直接使用 WSI patch 信息密度高(密集的视觉信号) → 简介的诊断报告(离散的文本标记) WS...

2025/8/22

我觉得我的日寄好阴暗啊,我是应该把阴暗的东西单独拿出去写吗? 今天新买的手机壳到了,这种几块十几块的东西偶尔买一买还是很能改善心情的。以前总想着忍一忍购买欲,省点钱给上学用(毕竟负债100w+),但是现在想一想即使省下来也是过于杯水车薪了。从美国回来之后,想着自己拼死拼活省的钱连半顿饭也吃不起。其实也无所谓了,这点钱不过是留学的~100w中 ~ 的一点点误差罢了。另外之前不知道在哪里看到说老中都是忍者,总是说再克制一下就好了,再忍一下就好了。麻麻的老子这辈子就是来享乐的忍个蛋。 最近有一种狂买东西的欲望,先买了一个magsafe充电支架,挺好的符合我的预期。架在桌子上配合息屏显示当一个桌搭挺好的。可是今天的手机壳装上之后磁性吸不上了!我每次到家之后还要把手机壳摘下来才能继续充电。这么做我又怕减少手机壳的寿命(7块钱的壳感觉也没什么心疼的)。我觉得上一个手机壳大概率是我经常拆装导致裂开的。现在这个壳完全严丝合缝的贴合,感觉有点不舍得。 现在还想要买一点神人T恤,正版的GBC一直没货,考虑淘宝上整一个,还能便宜一点。另外终于又找到了之前的没电T恤,感觉可以出手买下了。 尝试一下这里写...

击破队最后的辉煌(HSR3.0)

虚构更新前夜调了调仪器,把流萤速度堆到154尝试了一下。先是伤害差一点,把王贵人光锥换成决心后充能又不够了。击破绳换了充能绳之后应该是稳定0T了。虽然比较极限。 从此以后我再也没有用击破队打出过0T,现在甚至满心都有点困难,我还是二星魂完全体队伍呢。